上周,我们发布了 MMX-CLI,让 Agent 可以直接通过命令行调用 MiniMax 的全模态能力。命令行是 Agent 在终端中完成工作的常见形态,但用户的工作并不只发生在命令行内,电脑上还有大量任务藏在命令行无法触达的本地软件、内部系统和图形界面中。

今天,我们发布 MiniMax Agent 桌面端两项更新:

-

Pocket 功能上线(Beta 版),支持接入飞书、微信、企业微信、Slack 等主流 IM 通讯软件,让桌面智能体可以随身携带。用户在 IM 中唤起 Pocket 并发送指令后,Agent 即在其电脑上执行任务,并将结果回传至原对话。

-

Computer Use 功能上线,Agent 可以像人一样看屏幕、操作鼠标和键盘,直接操作用户电脑上的软件。本地安装的设计工具、内部的报表系统、藏在偏好设置中的开关、需要在多个应用之间手动衔接的流程——这些过去 Agent 难以触达的任务,现在都可以由它完成。

IM 与 Computer Use 还可以实现哪些实用的功能?我们看这样几个场景:

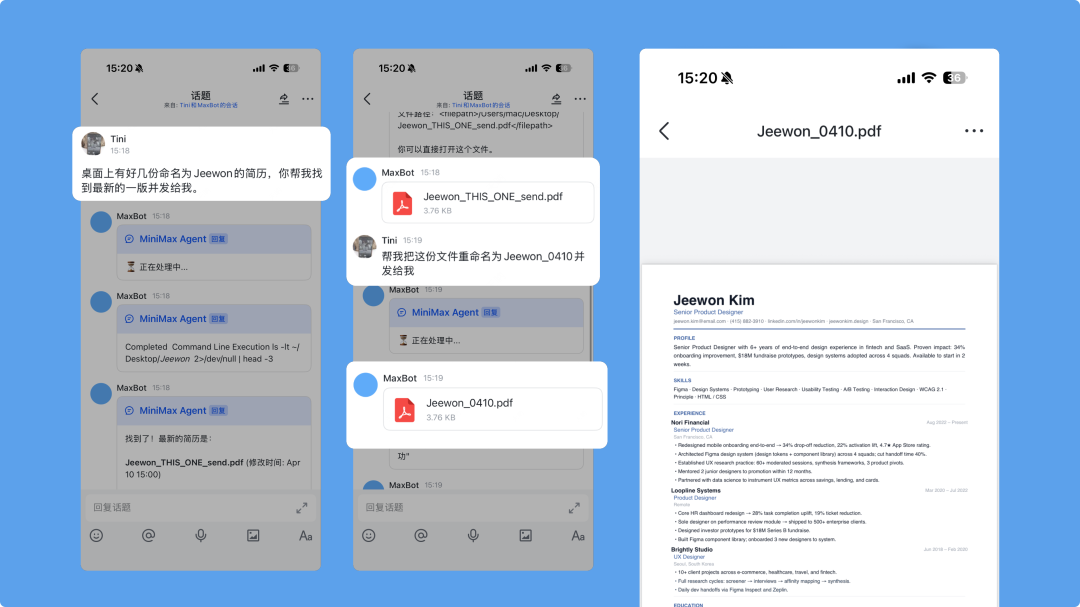

Case 1:远程找文件

Query: “帮我看下我桌面上是不是有一个 2025 report 的 pdf?找到并发给我。”

Agent 在用户电脑的桌面上定位文件,找到后将文件直接回传到原对话。用户在地铁上、会议中、出差途中都可以用同样的方式取用本地文件,不需要打开电脑。

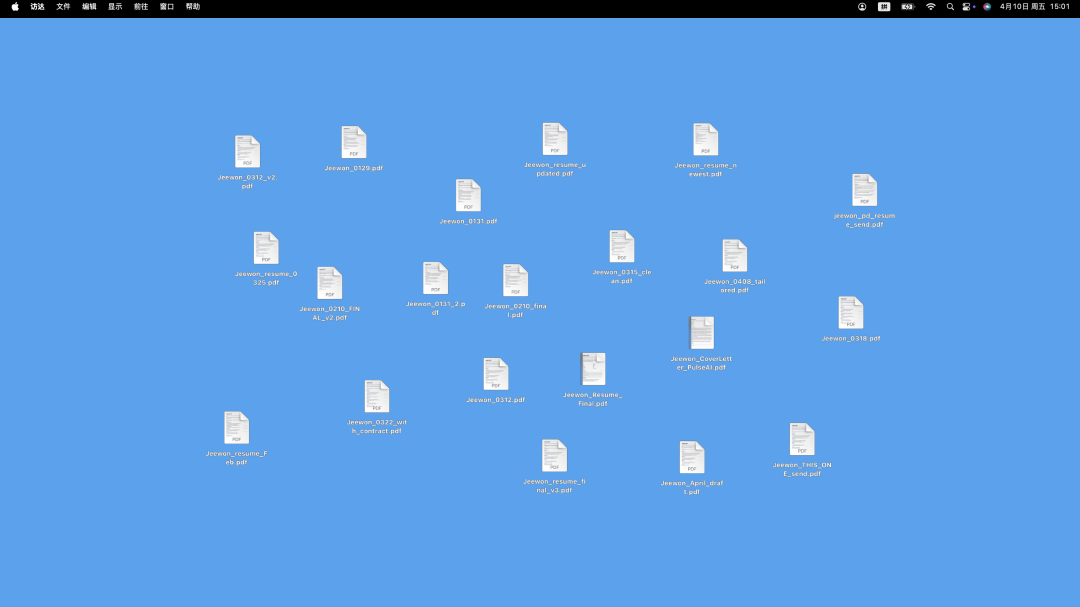

Case 2:筛选简历并生成飞书文档

Query: “读取桌面上 Resume 文件夹里的所有简历,根据设计经验年限、量化成果和技能匹配度,挑选最符合 AI Native 工作环境 Product Designer 岗位的 Top 3 候选人,并简要说明每人入选理由。根据这三人的具体经历出面试题,题型覆盖过去项目深挖 ×2、设计决策与方法论 ×2、协作与软技能 ×1、针对简历中某个值得追问的细节 ×1。整理成一份飞书文档,每位候选人独立成一个 Section。”

桌面上的零散简历

这个任务跨越两层能力:Computer Use 负责在用户电脑上读取 Resume 文件夹中的本地文件并理解每份简历的内容,飞书 CLI 负责将最终的候选人分析与面试题结构化写入飞书文档。Agent 完成后将文档链接回传至原对话,用户点击即可查看。

成功推送制定简历到飞书

Case 3:操作本地应用与系统设置

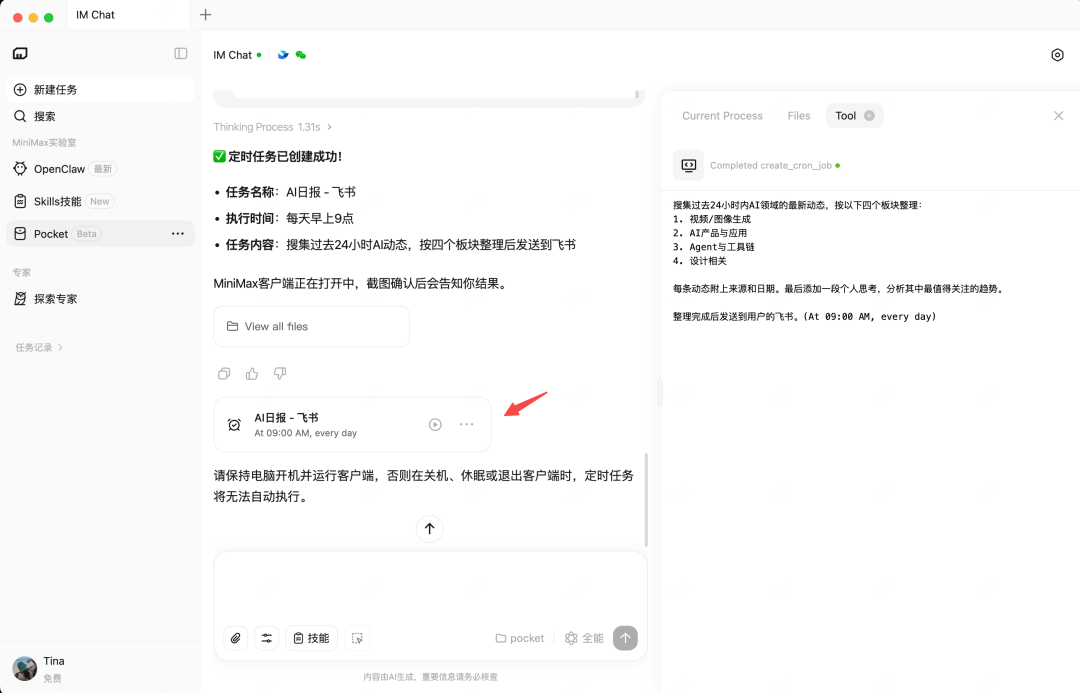

Query: “帮我打开系统设置,找到锁定屏幕,把不活跃时启动屏幕保护程序设为永不。然后打开 Pocket 客户端执行每日定时任务,完成后给我一张截图。”

Step 1:关闭屏幕保护程序

Step 2:设置每日定时任务

由于系统偏好设置没有公开的命令行接口,这些任务只能通过图形界面完成。Agent 基于 Computer Use 打开系统设置、定位到“锁定屏幕”面板、调整下拉菜单,随后启动客户端执行任务,最后截图回传。整个过程可以在 IM 中完整查看 Agent 的每一步操作。

飞书定时任务成功创建

从 Agent 可以操作电脑,到 Agent 可以稳定、准确、安全地完成用户交付的任务,中间是大量的工程工作。以下展开分享一些我们实现过程中的技术思考。

01

把工具拆开,而不是给 Agent 一个万能的 computer

一种常见的 Computer Use 实现方式是提供一个统一的 computer 工具,所有操作——无论是切换窗口、点击按钮还是操作网页——都通过像素坐标完成。这种做法结构简单,但在真实任务中精度和可靠性都难以保证。

我们将桌面操作拆成四个独立的工具域:

-

Desktop Control:截图、鼠标操作(含修饰键组合)、键盘输入、滚动、拖拽

-

Window Manager:窗口列表查询、聚焦、最小化/最大化、关闭、移动与缩放、应用启动

-

Browser Engine:DOM 操作、CSS 选择器定位、JavaScript 执行、结构化导航

-

Clipboard:系统剪贴板读写

这样做的原因是:不同任务的最优执行路径不一样。窗口管理可以直接调用系统 API,不需要让模型先截图再识别“最小化按钮在哪”;浏览器中的元素通过 DOM 选择器定位,比让模型数像素点击更精准;跨应用的数据传递通过剪贴板完成,比反复截图读取更可靠。

这套工具矩阵再叠加 lark-cli、wecom-cli、mmx 三套平台 CLI,以及 Bash 与文件系统工具,共计 60+ 个工具。Agent 在执行任务时,会根据任务类型选择最合适的工具路径。

02

视觉感知:让模型在不同屏幕上都能看清

Computer Use 的第一步是让模型“看到”屏幕,但用户的显示器千差万别——从 MacBook 的 Retina 屏到外接 4K 显示器,从 1080p 到普通 720p,物理分辨率甚至能跨越一个数量级。同一张截图,在不同设备上呈现给模型的细节密度完全不同。如果不做处理,模型会在高分辨率的屏幕上因为信息过载漏看元素,也会在低分辨率的屏幕上因为画面糊了点错按钮。

我们在两个层面解决了这个问题:

-

坐标系统的统一:模型不直接输出像素坐标,而是输出一个 0 到 1 之间的相对位置,由系统根据当前屏幕分辨率换算为真实坐标执行。模型不需要知道用户用的是什么屏幕,操作精度在所有设备上保持一致;

-

截图的自适应处理:我们会先以物理像素级精度截取屏幕,再根据模型的视觉输入上限动态缩放,确保模型收到的画面既清晰可读、又不超出处理范围。无论用户用的是 MacBook Retina 还是外接 4K 显示器,模型看到的都是经过适配的最优尺寸。

03

截图-验证-行动循环:

让多步任务可靠推进

单步操作的准确性只是基础,真实任务往往需要十几步甚至上百步连续操作才能完成。任何一步的错误,比如坐标识别偏差、窗口未及时聚焦、意外弹窗遮挡等,都可能导致后续步骤全部失败。

我们给每一步桌面操作都接上了一个验证环节:操作执行完,立刻自动截图,让模型看一眼“刚才那一步真的做到了吗”。如果符合预期就推进下一步;如果没有,则进入诊断流程,识别失败原因,并尝试替代方案(比如鼠标点不到的按钮换成键盘快捷键)。如果在一定的重试次数内仍然无法解决,Agent 会主动告诉用户具体卡在哪一步,而不是继续盲目尝试。

这个循环让 Agent 在真实任务中的失败率显著下降。多步任务里偶发的小问题被就地处理,不会累积成最后的全盘失败。

04

权限与远程授权

Agent 能直接操作用户电脑,意味着必须有清晰的权限边界——尤其是当用户不在电脑前、通过 IM 远程发出指令时。删一个文件、改一个系统设置,这些动作如果没有用户确认就直接执行,远程操控的便利就变成了风险。

我们把权限管理也放到了 IM 里。当 Agent 准备执行文件删除等操作时,会暂停下来,把这一步的具体内容推送到用户的 IM 对话里,在飞书和 Slack 中以卡片或交互组件呈现,用户点一下就能授权或拒绝;微信等不支持交互组件的平台则通过文本指令完成授权。任务执行过程中,用户也可以随时发送指令中止 Agent。

这样一来,即使用户不在电脑前,每一个关键动作也都经过用户本人的确认。用户能对 Agent 的每一个关键动作保持完整的知情权与控制权。

这次更新是我们在 Agent 基础能力上迈出的一步。CLI 覆盖可被 API 化的部分,Computer Use 接管需要依赖图形界面的部分,IM 作为统一的指令入口将两者随时唤起——Agent 能触达的工作范围由此扩展到用户真实的电脑桌面。

Pocket 和 Computer Use 作为能力而言,仍处于早期。模型在复杂界面下的识别精度、长任务中的稳定性、对新软件的泛化能力,都还有大量工程工作需要持续推进。我们会在后续版本里持续打磨。

MiniMax Agent 桌面端下载:https://agent.minimaxi.com/download

Intelligence with Everyone.

本文转载自MiniMax公众号,原文地址https://mp.weixin.qq.com/s/dmF0PRj6OMQ-TWAIoc-kqg

MiniMax Agent就是腾讯的WorkBuddy吗?