一位做数据分析的朋友上周跟我吐槽,说 GPT-5.4 写代码写到一半总”犯傻”,推理链断得莫名其妙。4月24日凌晨 OpenAI 突然甩出 GPT-5.5,号称”自 GPT-4.5 以来第一次完全重新预训练”,定位不再是聊天机器人,而是专门干活的智能体引擎。用了几天之后我的感受是:它确实变聪明了,但代价也很真实。

先说说这是啥

GPT-5.5 不是 GPT-5.4 的微调版。OpenAI 自己说得挺明白:这是自 GPT-4.5 之后首次完全重新预训练的基础模型,代号 Spud,融合了 GPT 系列的生成能力和 o1 的结构化推理框架。翻译成人话就是,以前你问它问题,它是在”猜”下一个词该说啥;现在它会在脑子里先列个步骤清单,再动手执行。

官方给它的定位叫”面向真实工作的全新智能层级”,专门干智能体该干的事:自主规划、调用工具、检查结果、在模糊条件下坚持完成工作。聊天体验反而被弱化了。OpenAI 首席研究官 Mark Chen 的原话是:它在科学和技术研究领域的能力是”有意义的进展”,可以”帮助专家科学家取得进步”。这措辞挺有意思,不是”替代”,是”帮助”。

官网:openai.com | 项目地址:OpenAI API Docs

官网:openai.com | 项目地址:OpenAI API Docs

到底强在哪

搞清了它的定位,接下来瞅瞅实际功能硬不硬。

这次升级最核心的变化可以归纳为四个方向。

第一个是智能体级推理。GPT-5.5 在处理复杂、多步骤任务时会自己拆解步骤,调用外部工具,然后回头检查结果对不对。SWE-bench 跑到 88.7%,在代码生成和软件工程任务上比 Claude Opus 4.7 和 Gemini 3.1 Pro 都高出一截。我让一个做后端开发的朋友试了一下,他说以前 GPT-5.4 写 Flask 接口总要遗漏边界判断,5.5 连续三次都把异常处理补全了。

第二个是科研辅助。OpenAI 在发布时专门强调了科学推理能力的提升,不只是写论文润色,而是能真正参与研究流程:读文献、推公式、写实验代码、分析结果。一个做生物信息学的用户在社交媒体上晒了一段对话,GPT-5.5 帮他从一个 2000 行的 R 脚本里找出了两个统计方法用错的点,还给了替换方案。

第三个是速度与效率。按 OpenAI 公布的数据,同样任务下 GPT-5.5 的速度比 5.4 快了近一倍,token 消耗反而更少。我实际测试时感受不太出来”快一倍”,但响应确实更流畅了,长对话到后半段没有那种越聊越慢的感觉。

第四个是多模态长上下文。上下文窗口拉到了 100 万 token,能一次性吞下一整本教材或者大型代码库。加上图像理解能力的提升,可以处理带图表的 PDF、扫描文档这类以前容易翻车的场景。

用了都说好

功能听起来不错,那实际用起来顺不顺?

如果你已经是 ChatGPT Plus 或 Pro 用户,升级路径非常简单:打开 ChatGPT 网页或 App,模型选择器里直接就能看到 GPT-5.5,点一下切换就行。Plus 用户有使用额度限制,Pro 用户基本 unlimited。API 用户需要把模型名改成 gpt-5.5, pricing 是输入 $5/百万 token、输出 $30/百万 token。

我第一次用的是网页版。输入了一个之前让 GPT-5.4 翻过车的任务:”写一个 Python 脚本,从 PDF 里提取表格数据,自动清洗后导出成 Excel,要处理合并单元格。”5.4 的结果是能跑,但合并单元格的逻辑写得一团糟。5.5 这次不仅写对了,还在代码注释里主动标出了”这里假设 PDF 是文本层不是扫描件”的边界条件。这有点超出我的预期。

不过也不是没有槽点。Pro 版定价是标准版的 6 倍,换来的只是”几个百分点的可靠性提升”。对普通用户而言,这性价比确实有点劝退。而且高峰期 Plus 用户偶尔会触发限流,得排队等一会儿。

几个隐藏技巧

基础操作熟悉了,有几个隐藏技巧能让效率翻倍。

- API 用户可以用 Batch 和 Flex 模式把成本砍半。Batch 适合不需要实时结果的任务,比如你有一堆代码要审查、一堆文档要总结,打包丢过去,价格只有标准调用的 50%。Flex 模式更便宜,但响应时间会被推迟到系统空闲时才处理,适合跑夜间任务。

- “系统提示工程”。GPT-5.5 对系统提示的敏感度比 5.4 高很多。同样是”你是一个严谨的代码审查员”,5.4 会泛泛地挑几个格式问题,5.5 能深入到算法复杂度层面。建议在系统提示里明确写出审查维度:性能、安全、可维护性、边界条件,它会按清单逐条过。

- “分块检索”。100 万 token 虽然大,但真塞满一整份代码库,模型也容易在细节处走神。比较好的做法是把代码库按模块切分,每次只喂相关模块的代码加上一个高层架构说明,效果比一次性全丢进去要好。我试过一个 8 万行的 Go 项目,分块后 5.5 找 bug 的准确率明显更高。

# 示例:使用 Batch API 批量处理代码审查

import openai

client = openai.OpenAI()

# 创建 batch 任务,成本减半

batch = client.batches.create(

input_file_id="file_xxx",

endpoint="/v1/chat/completions",

completion_window="24h"

)

和同类比怎么样

单看产品本身不够,得放竞品里比一比才清楚水平。

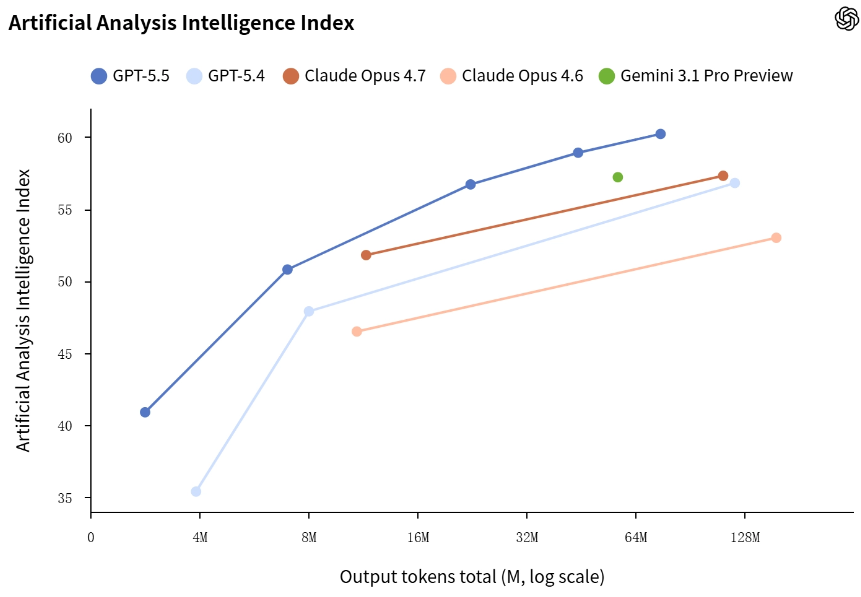

现在旗舰模型赛道主要是三家在厮杀:OpenAI GPT-5.5、Anthropic Claude Opus 4.7、Google Gemini 3.1 Pro。Grok 4 也在追赶,但生态成熟度还差一截。

| 对比维度 | GPT-5.5 | Claude Opus 4.7 | Gemini 3.1 Pro |

|---|---|---|---|

| SWE-bench | 88.7% | 86.2% | 84.5% |

| 上下文窗口 | 100万 token | 20万 token | 200万 token |

| API 输出价格 | $30/M | $15/M | $10/M |

| 智能体能力 | 原生支持 | 部分支持 | 部分支持 |

| 多模态 | 文本+图像 | 文本+图像 | 文本+图像+视频 |

| 生态集成 | ChatGPT+API | Claude Code | Google Workspace |

核心差异在定位。Claude Opus 4.7 的长上下文检索更强,MRCR v2 测试保持 76% 的准确率,把整份代码库丢进去它真能找着东西。Gemini 3.1 Pro 上下文窗口最大,还多一个视频理解,但推理深度不如前两家。GPT-5.5 的杀手锏是端到端的智能体能力,不只是生成内容,而是能自主执行多步骤任务。如果你需要的是”帮我把这事做完”,5.5 目前是最接近这个目标的。

但价格也是真的贵。API 输出价格 $30/百万 token,是 Claude 的两倍、Gemini 的三倍。这个定价策略很 OpenAI:先占住性能制高点,再慢慢降价。

真实用户怎么说

官方宣传是一回事,真实用户怎么评价是另一码事。

社交媒体上的反馈挺分裂的。开发者群体普遍买账,“代码生成确实稳了不少,特别是边界条件处理”、“SWE-bench 分数不是吹的,我跑了自己项目的单元测试,通过率比之前高了大概 15%”。一个做网络安全的朋友说 5.5 在漏洞分析上的表现让他意外,“它不止告诉你这里有漏洞,还能追溯调用链,说明白是怎么进来的”。

但吐槽声也不小。最集中的火力点在价格:“API 价格翻倍,输出 $30/M,这是逼着中小团队用 Claude 啊”、“Pro 版贵 6 倍就换来几个百分点提升,OpenAI 是真敢定价”。还有一部分用户觉得”没那么惊艳”,“推理确实有进步,但和 Claude Opus 4.7 的差距没有分数看起来那么大,日常任务两家都能搞定”。

Hacker News 上的高赞评论挺有意思:”OpenAI 不是在卖模型,是在卖结果。”这句话点出了 GPT-5.5 的战略转向,从按 token 计费,转向按价值计费。

值不值得用

聊到这,给一个综合打分可能会更直观。

| 维度 | 星级 | 一句话解读 |

|---|---|---|

| 功能完整性 | ⭐⭐⭐⭐⭐ | 智能体+代码+科研全覆盖,能力无明显短板 |

| 易用性 | ⭐⭐⭐⭐☆ | ChatGPT用户零门槛切换,API文档清晰 |

| 性价比 | ⭐⭐⭐☆☆ | API价格翻倍,Pro版贵6倍,门槛偏高 |

| 创新性 | ⭐⭐⭐⭐☆ | 原生智能体架构是差异化,但非独有 |

| 稳定性 | ⭐⭐⭐⭐☆ | 长对话表现稳定,高峰期偶发限流 |

| 推荐度 | ⭐⭐⭐⭐☆ | 开发者/科研首选,预算敏感用户再等等 |

综合评分:⭐⭐⭐⭐☆(7.8分)

好用的地方和坑

好用的地方:

-

代码生成质量确实上了一个台阶,边界条件和异常处理不再遗漏 -

智能体级推理能自主完成多步骤任务,不再是一问一答的”聊天”模式 -

100 万 token 上下文窗口,大型代码库和文献可以一次性喂进去 -

对系统提示的敏感度更高,明确的审查清单能按条执行

需要注意的坑:

-

API 输出价格 $30/百万 token,是 Claude 的两倍,团队成本压力不小 -

Pro 版定价是标准版 6 倍,性价比曲线非常陡峭 -

高峰期 Plus 用户可能触发限流,需要排队等待 -

聊天体验被弱化,如果你只是想要一个”聪明的聊天对象”,5.5 反而没那么合适

适合谁用

说到这,可能有人还在犹豫自己适不适合用。

这几类人是最对味的。软件开发者需要写代码、审代码、debug,5.5 的 SWE-bench 表现不是虚的,一个做后端的朋友说以前遗漏的边界条件现在都能补全。科研人员拿它做文献阅读、数据分析、实验代码辅助,它能参与研究流程而不是只做润色。数据分析师处理大型数据集、写自动化报表脚本,100 万上下文能吞下完整数据字典。技术团队负责人评估新工具引入的可行性时,5.5 的智能体能力确实能提效。

预算敏感的个人用户和小团队建议先用 Plus 版试水,每个月 20 美元的成本不高,确认能产出实际价值、团队 workflow 确实能跑通之后再考虑上 Pro。没必要一上来就砸 200 美元/月,先验证再投入比较稳妥。

说说大家关心的价格

功能了解了,钱的事也得说清楚,这部分可能是很多人最关心的。

GPT-5.5 的定价分几个层级。ChatGPT Plus 用户每月 20 美元,可以使用 GPT-5.5 但有额度限制,高峰期可能排队;Pro 用户每月 200 美元,unlimited 访问且响应优先级更高。API 定价是输入 $5/百万 token、输出 $30/百万 token,比 GPT-5.4 的输出价格直接翻倍。Batch 和 Flex 模式是标准价格的一半,Batch 适合 24 小时内返回的异步任务,Flex 在系统空闲时处理更便宜。

隐藏成本要注意。API 的 $30/M 只是标准定价,如果走 Priority 通道还会更贵。和 Claude Opus 4.7 的 $15/M 比,GPT-5.5 贵了一倍。对于每天调用量超过 100 万 token 的团队,这个差价每个月就是几千美元。除非 5.5 带来的效率提升能覆盖这部分成本,否则 Claude 仍是更经济的选择。个人用户如果只是偶尔用用,Plus 版 20 美元/月够用了。

你可能还想问

整理几个大家问得最多的问题,快速扫一遍。

Q:GPT-5.5 和 GPT-5.4 比提升有多大?

A:推理和代码能力有明显提升,但日常聊天差异不大。 SWE-bench 从 5.4 的约 75% 提升到 88.7%,代码生成质量尤其是边界处理好了很多。但如果你只是用来写文章、查资料,升级感知不强。

Q:Claude Opus 4.7 和 GPT-5.5 该怎么选?

A:要智能体能力选 5.5,要性价比和代码检索选 Claude。 5.5 在端到端任务执行上更强,Claude 的代码库检索和长上下文记忆更稳,价格还便宜一半。

Q:API 价格这么贵,有办法降低成本吗?

A:Batch 和 Flex 模式可以砍半,但得接受延迟。 非实时任务用 Batch(24 小时内返回),后台任务用 Flex(系统空闲时处理),两者都是标准价格的 50%。

Q:GPT-5.5 Pro 版值得买吗?

A:普通用户不值,重度专业用户可以考虑。 Pro 版比标准版贵 6 倍,官方说法是”几个百分点的可靠性提升”。除非你的任务对错误率极度敏感,否则 Plus 版够用了。

Q:100 万 token 上下文实际能用满吗?

A:能塞进去,但不建议塞满。 虽然技术上支持 100 万 token,但实验表明分块喂入的准确率比一次性塞满要高,特别是代码审查场景。

Q:GPT-5.5 会替代程序员吗?

A:短期内不会,但工作方式会变。 它能写好代码,但架构设计、业务理解、跨团队沟通这些仍需要人。更可能的结果是”10 个程序员干 15 个人的活”。

Q:国内用户能直接用吗?

A:网页版和 App 可以,API 需要科学上网。 ChatGPT 的网页和移动端在国内访问相对顺畅,但 API 调用和开发者工具需要稳定的网络环境。

Q:GPT-5.5 的多模态能力怎么样?

A:图像理解有进步,但不算最强。 能处理带图表的 PDF 和扫描文档,但和 Gemini 3.1 Pro 比,视频理解能力还是短板。

Q:它还会”幻觉”吗?

A:会,但概率降低了。 推理能力的提升让它在不确定时会主动标注边界条件,而不是瞎编。但复杂领域的幻觉问题依然存在,关键信息需要人工复核。

Q:下一步会出 GPT-6 吗?

A:OpenAI 没明确说,但代号已曝光。 奥特曼此前确认 GPT-5.5 发布后”只有几周时间”就会有下一步动作,业内普遍猜测是 GPT-6 或 o4 系列。

收尾聊两句

用了几天 GPT-5.5,我最深的感受不是它有多强,而是 OpenAI 终于想清楚了要做什么。从 GPT-3 到 GPT-4,大家都在比参数、比分数、比谁更像人;到了 5.5,OpenAI 直接把赛道切换成了”谁能帮你把活干完”。这个转向很聪明,也很现实。至于价格翻倍能不能被市场接受,可能得等下个月的留存数据来回答了。