调个 DeepSeek 还得翻墙绑外币卡?硅基流动的出现就是为了治这个病。这家 2023 年成立的公司,现在平台上架了 150+ 开源模型,从 DeepSeek 到 GLM 到 Qwen 全都有,还兼容 OpenAI 的调用格式。自研推理引擎把速度拉高了 10 倍,价格却只有官方的零头。最高光的是,DeepSeek-V4-Flash 输入才 1 毛钱一百万 tokens。但这平台也不是无脑吹,高峰期排队、闭源模型覆盖少、Streaming 偶尔断流。值不值得换过来,看完全文再做决定。

产品概述

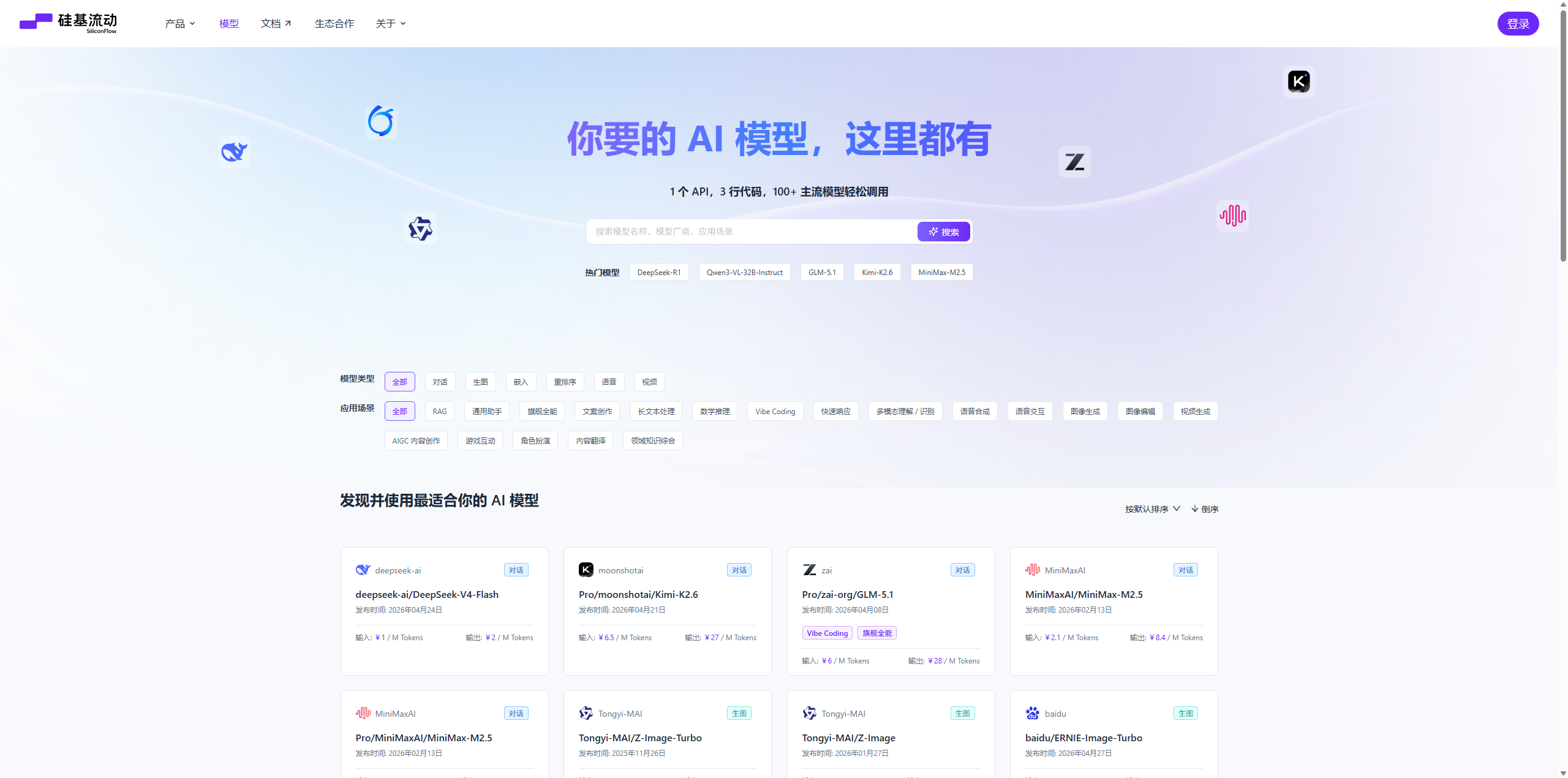

硅基流动(SiliconFlow)是国内领先的 AI 模型即服务平台,由前 OneFlow 创始人袁进辉于 2023 年创立,总部在北京。核心是做一件事,把 DeepSeek、Qwen、GLM、Kimi 这些开源大模型,用更低的价格和更快的速度交付给开发者和企业。

跟阿里云百炼这种绑定自家模型生态的平台不同,硅基流动主打第三方中立定位,不自研基础模型,而是把市面上能用的开源模型全部集齐。

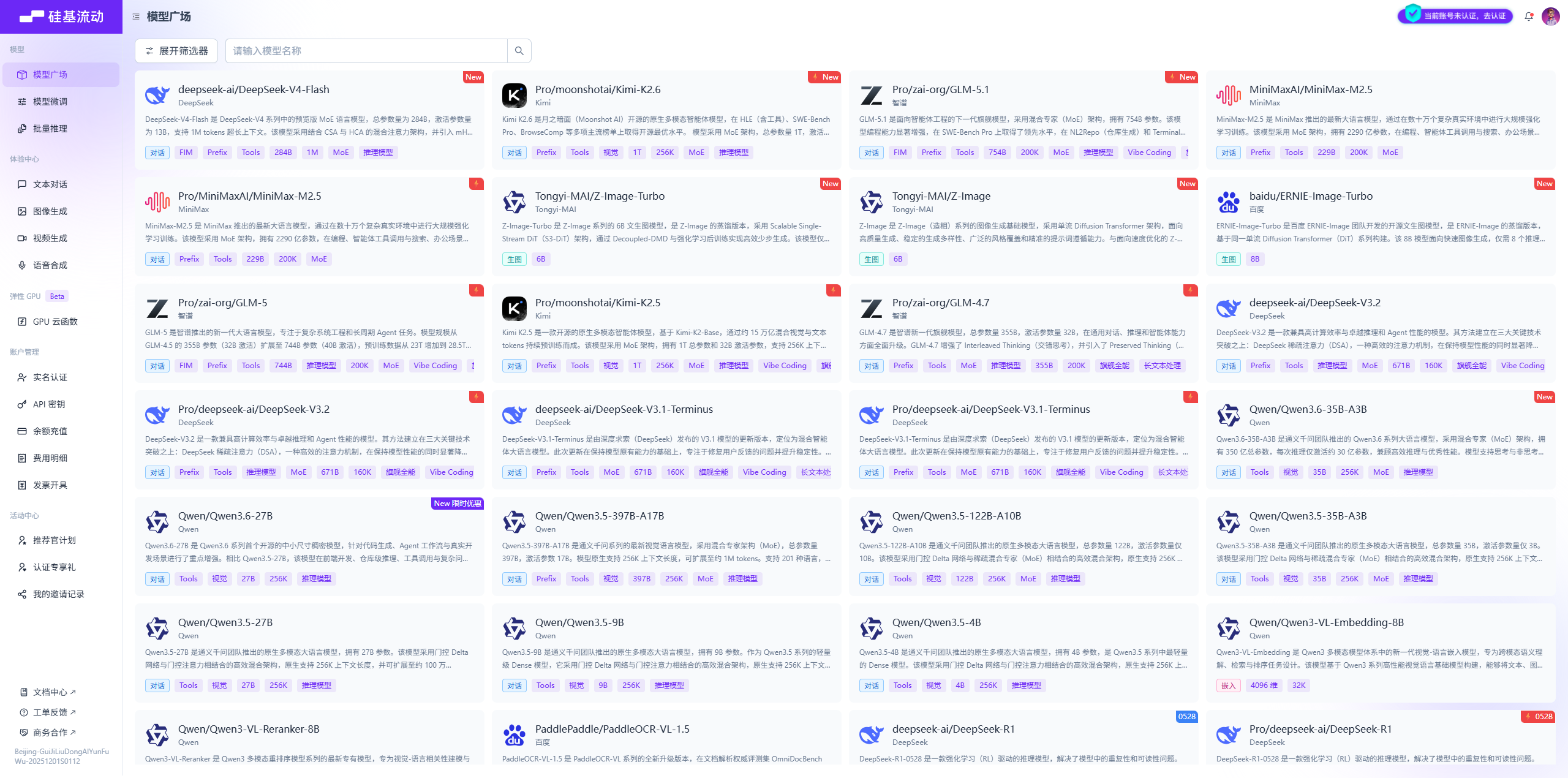

目前平台上架了 150+ 款模型,覆盖语言、图像、视频、语音等模态,注册用户已突破 900 万,企业用户超过 1 万家。自研的 SiliconLLM 推理引擎在底层做了大量优化,官方宣称语言模型推理速度提升了 10 倍以上,图像生成能做到 1 秒出图。对于正在选 MaaS 平台的开发者来说,这是个绕不开的名字。

官网:https://siliconflow.cn | 项目地址:https://github.com/siliconflow

到底强在哪

概念说完了,来拆开看看这家公司到底凭什么吸引上百万开发者。

硅基流动的核心能力可以概括为四个板块。

- SiliconCloud 是最直接的入口,开发者注册后拿到 API Key 就能调模型,兼容 OpenAI 的接口格式,之前用 GPT 的代码几乎不用改。

- SiliconLLM 是底层的推理加速引擎,负责把各种模型的推理速度拉满。

- OneDiff 则专注图像和视频生成场景,FLUX 系列出图能做到秒级响应。

- BizyAir,一个 ComfyUI 云节点平台,不用本地显卡就能跑图。

具体来看它支持的模型阵容和关键定价,直接上表:

| 模型类别 | 代表模型 | 输入价格($/M tokens) | 输出价格($/M tokens) |

|---|---|---|---|

| 推理旗舰 | DeepSeek-V4-Flash | 0.14 | 0.028 |

| 通用大模型 | Qwen3-VL-32B | 0.20 | 0.60 |

| 国产模型 | GLM-5.1 | 1.40 | 0.26 |

| 多模态 | Kimi-K2.6 | 0.95 | 0.16 |

| 图像生成 | FLUX.1 | 0.04/张 | — |

| 视频生成 | Wan2.2-T2V-A14B | 0.29/个 | — |

DeepSeek-V4-Flash 的输出每百万 tokens 只要 2 分 8 厘钱,这个价格在同类平台里几乎是地板价。图像方面 Z-Image-Turbo 更是杀到了 5 厘钱一张。

从零开始试

功能参数再好看,不如动手跑一次来得实在。注册到调通第一个 API,总共花了不到十分钟。

打开官网直接用邮箱注册,不需要企业认证也不需要绑信用卡,注册完就送 1 美元的免费额度。到控制台创建 API Key 之后,文档站上直接有 Python 示例代码,复制粘贴就能跑通。

我试了 DeepSeek-V4-Flash,从发出请求到收到第一个 token,延迟大概在 400 毫秒出头。这对日常对话类应用来说完全够用。图像生成那边更惊艳,用 FLUX.1-dev 跑了一张 1024×1024 的图,大概两秒出图,质量跟本地跑的效果差不多。

不过也有槽点。那几天正好赶上 GLM-5 刚上线,热度爆棚,GLM-5 的接口开始排队,TTFB 直接飙到了 2 秒以上。平时秒回的模型在高峰期也出现了十几秒的等待。如果业务对延迟有硬性要求,得提前做好排队预案。

几个隐藏技巧

上手阶段试的是基础调用,实际用下来有些技巧能让体验再上两个台阶。

-

巧用免费模型试错:硅基流动上有不少免费或超低价模型(比如 Hy3-preview 现阶段完全免费),开发阶段先用这些模型调试 prompt 和业务流程,确认没问题再切到正式模型跑生产。这样能把测试成本压到几乎为零。 -

设置月度消费上限:在账户仪表板可以设置每月的支出上限。对于个人开发者或小团队来说,这个功能很实用,防止某次批量测试跑飞了直接刷爆预算。 -

利用高吞吐模型做批处理:如果要做大批量的离线推理任务,优先选那些输出价格极低的模型,比如 DeepSeek-V4-Flash 输出才 2 分 8 厘。用这些模型做批处理,能把单条成本压到传统方案的五分之一以下。 -

多模型组合策略:不同场景用不同模型。需要用长上下文时切 DeepSeek-V4(上下文 1049K),需要多模态理解时用 Qwen3-VL。硅基流动的 API 切换模型只需改一个参数,很适合做多模型编排。

和同类比怎么样

自己用着顺手还不够,放到整个 MaaS 赛道里比比才知深浅。这个赛道的玩家分三类:大云厂商的 AI 平台(阿里百炼、火山引擎方舟)、海外开源聚合平台(Together AI、OpenRouter)、以及国内独立 MaaS 创业公司(硅基流动、无问芯穹)。

| 对比维度 | 硅基流动 | 阿里云百炼 | Together AI | OpenRouter |

|---|---|---|---|---|

| 模型数量 | 150+(开源为主) | 自有生态 + 第三方 | 200+ | 300+(含闭源) |

| 闭源模型支持 | ❌ 仅开源 | ✅ Claude/GPT 均有 | ✅ 部分 | ✅ 全链路 |

| TTFB | 420ms | 未公开 | ~500ms | ~680ms |

| 定价竞争力 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| 国产算力适配 | ✅ 昇腾等 | ✅ 自家飞天 | ❌ | ❌ |

| OpenAI 兼容 | ✅ | ✅ | ✅ | ✅ |

| 免费额度 | $1 积分 | 免费试用 | $25 赠金 | 无 |

核心差异在于定位。硅基流动在开源模型生态上最强,价格也最敢打,DeepSeek 系列因为投资关系,拿到的价格优势是竞品没法比的。但如果你需要调 Claude 或 GPT,硅基流动用不了,得再找一个聚合平台做补充。

真实用户怎么说

参数上赢了,来听听真正用的人怎么说。社交媒体和开发者社区里关于硅基流动的讨论不算少。

好评的声音集中在模型上新速度和调用体验上,GLM-5 开源当天就能用,DeepSeek V3 的调用稳定性和速度对得起它作为投资方的身份。中文文档对国内开发者非常友好,不用硬啃英文文档这一点被反复提及。

差评的炮火主要打向高峰期性能和模型覆盖。有开发者反馈 GLM-5 上线那几天排队严重,接口 TTFB 翻了五倍。还有用户在 24 小时连续测试中遇到了 Streaming 模式偶发断流的问题,请求没返回错误码但回答到一半突然断了。闭源模型的缺失也是高频槽点。

多维评分

正反评价都摆出来了,从专业维度给它打个分。

| 维度 | 评分 | 一句话解读 |

|---|---|---|

| 功能完整性 | ⭐⭐⭐⭐☆ | 150+ 模型覆盖全面,缺闭源生态 |

| 易用性 | ⭐⭐⭐⭐⭐ | OpenAI 兼容,API 文档清晰 |

| 性价比 | ⭐⭐⭐⭐⭐ | DeepSeek 输入价仅 $0.14/M tokens |

| 创新性 | ⭐⭐⭐⭐☆ | 自研推理引擎,10x 加速亮眼 |

| 稳定性 | ⭐⭐⭐☆☆ | 高峰期排队,Streaming 偶发断流 |

| 推荐度 | ⭐⭐⭐⭐☆ | 开源模型首选,闭源需求绕道 |

| 综合评分:8.2 / 10 |

优点和槽点

优势

-

开源模型之王:150+ 模型覆盖全,上新速度业界最快,GLM-5 开源当天就能用 -

极致性价比:DeepSeek-V4-Flash 输出仅 $0.028/M tokens,Z-Image-Turbo 出图 5 厘一张 -

开发者友好:兼容 OpenAI 接口,中文文档完善,注册即送免费额度 -

国产算力加持:支持华为昇腾部署,满足政企信创需求

不足

-

闭源模型缺席:Claude、GPT 等闭源模型不支持,需要搭配其他平台使用 -

高峰期性能波动:热门模型上线时排队严重,TTFB 从 420ms 飙到 2s+ -

Streaming 偶发断流:24h 测试出现过 3 次断流,业务需要做重试兜底

适合谁用

分数说明了一部分问题,但买不买单最终看的是需求匹配度。

-

个人开发者和独立开发者:最理想的 MaaS 入门平台。免费额度够跑 demo,按量计费没有最低消费,调通第一个模型十分钟搞定 -

中小型技术团队:开源模型供应链首选。用硅基流动跑 DeepSeek 和 Qwen,用聚合平台补闭源模型,成本能压到最低 -

AI 应用创业者:如果产品用的是开源模型,硅基流动的成本优势能直接体现在毛利率上。批处理场景尤其省钱 -

政企客户:有国产算力和私有化部署需求的话,硅基流动的昇腾适配和 MaaS 私有化方案在国内是独一份 -

重度闭源模型使用者:不太适合。需要同时调 Claude、GPT 的场景,硅基流动目前覆盖不了

多少钱

产品和场景对上了,来看看钱包受不受得了。

硅基流动采用的是纯按量计费模式,没有月租概念,也没有最低消费。注册即送 1 美元免费额度,可以在控制台设置月度支出上限防止超支。

| 模型类型 | 代表模型 | 计价单位 | 价格 |

|---|---|---|---|

| 语言模型 | DeepSeek-V4-Flash | 每百万 tokens | 输入 $0.14 / 输出 $0.028 |

| 语言模型 | GLM-5.1 | 每百万 tokens | 输入 $1.40 / 输出 $0.26 |

| 图像生成 | FLUX.1 [pro] | 每张 | $0.04 |

| 图像生成 | Z-Image-Turbo | 每张 | $0.005 |

| 视频生成 | Wan2.2-T2V-A14B | 每个视频 | $0.29 |

这个定价在同类平台里属于第一梯队。DeepSeek-V4-Flash 的输出价格比官方 API 还便宜,图像生成那边 Z-Image-Turbo 的五厘一张基本上是把成本打到了地板。对于高频调用场景,硅基流动的性价比优势会越用越明显。

常见问题

分数摆在这了,有些细节你可能还想搞清楚。

Q1:硅基流动有免费额度吗?

A1:新用户注册即送 1 美元免费额度。 不需要绑信用卡,1 美元足够跑几十次小模型的 API 调用,用来做功能验证和技术调研完全够用。

Q2:硅基流动支持哪些模型?

A2:目前平台上线了 150+ 款模型。 主力阵容包括 DeepSeek、Qwen、GLM、Kimi、MiniMax、FLUX、Wan 等系列,覆盖语言、图像、视频、语音多模态。

Q3:能不能直接用 OpenAI 的 SDK 调用?

A3:完全可以。 硅基流动的 API 兼容 OpenAI 接口格式,只需要把 base_url 改成硅基流动的地址,再把 API Key 换一下,之前写好的代码不用做其他改动。

Q4:高峰期为什么延迟这么高?

A4:热门新模型上线时调用量激增,导致接口排队。 实测数据显示平时 TTFB 约 420ms,高峰期可能超过 2 秒。建议避免在模型首发热度期跑生产任务。

Q5:硅基流动支持国产算力吗?

A5:支持,而且这是它的核心差异化能力。 平台已适配华为昇腾芯片,面向政企客户提供基于国产算力的私有化部署方案。

Q6:生成的图片和视频可以商用吗?

A6:通过硅基流动 API 生成的内容,版权归属取决于对应模型的开源协议。 建议在使用前确认具体模型的开源许可条款,商用场景需要特别注意合规要求。

Q7:硅基流动和 DeepSeek 官方 API 有什么区别?

A7:硅基流动是 DeepSeek 的投资方,DeepSeek V3/V4 调用体验有保障。 价格上硅基流动比官方稍低,而且不需要海外支付方式。但官方 API 在最新模型的首发时效上更快。

Q8:Streaming 模式断流怎么处理?

A8:目前没有完美的解决方案,建议在客户端做好超时重试。 实测 24 小时测试中出现过 3 次断流且未返回错误码,建议实现超时检测和请求重发逻辑。

Q9:企业如何接入硅基流动的私有化部署?

A9:企业客户可以联系销售团队定制私有化方案。 支持 BYOC 部署,提供算力隔离和三层安全隔离(计算/网络/存储),满足政企高安全要求。

Q10:硅基流动有客户支持吗?

A10:有中文技术支持,但响应速度一般。 社区渠道包括 GitHub 和开发者群聊,企业客户可以按 SLA 获得专属支持服务。

最后的结论

硅基流动是当前国产 MaaS 赛道上把“开源模型 + 高性价比 + 国产算力”这个组合打得最齐的平台。150+ 模型、兼容 OpenAI 接口、推理速度拉满,加上 DeepSeek 投资方带来的价格优势,让它在开源模型场景下几乎没有对手。

但它也有明显的偏科,闭源模型缺席、高峰期排队、Streaming 稳定性有待加强。如果你是开源模型的重度用户,或者有国产算力需求,它值得作为主力平台。如果业务依赖 Claude 和 GPT,建议把它当成开源模型专用通道,再配一个聚合平台做补充。