让 AI 自己去查资料、做报告、建网站,听起来很爽,但 Manus 真的做到了几分?这款由前 Monica 团队打造的通用 Agent,上线即爆火,GAIA 测试力压 OpenAI Deep Research。随后被 Meta 花 20 亿美元买下,又遭国家发改委叫停,产品未稳,风波不断。实测下来,研究和数据采集是强项,编程开发却一言难尽。$19 起步不算贵,但服务器稳定性扣了不少分。一句话:想做深度调研,它是个好帮手;想写代码,还是换一个。

产品概述

Manus 是 Butterfly Effect(蝴蝶效应)开发的通用型 AI Agent,前身是 Monica AI 浏览器助手团队,2025 年 3 月 6 日上线,一夜之间在科技圈刷屏。名字取自拉丁语”手”,不要只给建议,要直接帮你做完。跟 ChatGPT 那种聊完还得自己动手的产品完全不同,Manus 接到任务后会自主规划、在云端沙盒里执行,最后把成品交到你手上。

它背后用的不是单一大模型,而是多模型协同,Claude 负责内容结构,阿里的 Qwen 做语言理解和推理。在专门测试 AI 代理人”真实世界问题解决能力”的 GAIA 基准上,Manus 拿到 SOTA,三个难度级别都超过了 OpenAI 的 Deep Research。这成绩说明它不只是个花架子。

但 Manus 的命运动荡程度不亚于它的技术热度。2025 年底 Meta 以超过 20 亿美元完成收购,创始人肖弘在十余天内敲定交易。Manus 随即于 2026 年 1 月 5 日停止对中国境内用户服务。然而 4 月 27 日,国家发改委正式叫停该收购案,要求撤销交易。当前产品走向存在巨大不确定性。

核心功能

说了一堆概念,那实际能干哪些事?Manus 的功能矩阵远比一个”聊天机器人”丰富,六个模块覆盖了从研究到交付的全链路。

| 功能模块 | 一句话描述 | 亮点 |

|---|---|---|

| Wide Research 深度研究 | 数十到上百个子 Agent 并行搜索 | 来源逐一标注,信息差极大 |

| AI Slides 简报生成 | 自动研究内容+设计版面 | 输出可编辑的 PPT/Google Slides |

| AI Design 设计生成 | 图片、封面、菜单等视觉素材 | 2025 年中加入视频生成 |

| Website Builder 网站建站 | 一键架设 SEO 优化网站 | 从设计到部署一条龙 |

| Browser Operator 浏览器操控 | Chrome 扩展,AI 帮你填表单 | 使用你已登录的账号和 Cookie |

| My Computer 桌面控制(2026.3) | 云端到本地的边界被打破 | 最新重磅升级 |

最值得展开说的是 Wide Research。它不是搜几个网页然后拼个摘要,而是同时派出几十个代理,每个负责一个数据源,最后汇总成带来源标注的完整报告。对做市场调研、竞品分析的人来说,半天的工作量压缩到十几分钟。

AI Slides 和 Website Builder 也属于”交付型”功能,不是给你一个初稿让你自己改,而是直接出成品。这个思路贯穿了整个产品设计:Manus 不想做中间件,它想当那个干完活交差的人。

上手体验

功能听起来挺全,但注册到用上到底顺不顺?目前 Manus 采用邀请制,排队名单一度超过 200 万人。拿到资格后,用 Google 账号或邮箱就能登录,主界面就是一个简洁的任务输入框。

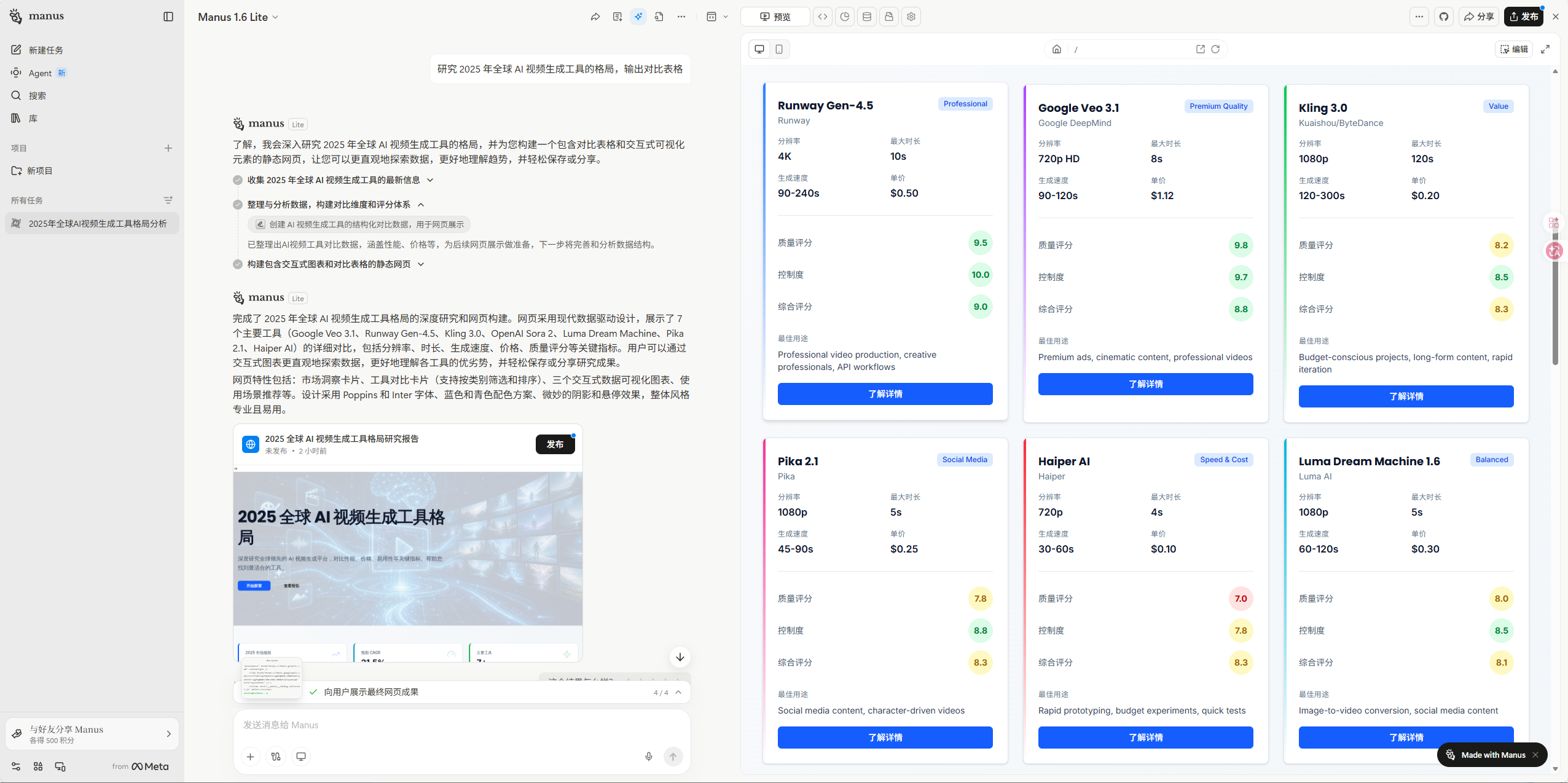

我试了第一个任务:”研究 2025 年全球 AI 视频生成工具的格局,输出对比表格。”提交后过了大概 5 秒,Manus 开始行动,先是弹出一个实时工作台,能看到它当前在打开哪个网页、读取什么内容。整个过程大概跑了 10 分钟,最后输出了一份带 20 多个数据源的详细报告,每个结论后面都标注了来源。第一感受是惊讶,这确实是真干活,不是随便糊弄。

但槽点也不少。免费账号每天只有 300 积分,一个复杂研究任务可能用掉几百点,没跑几个任务就提示额度不足。另外云端 VM 的启动速度不稳定,高峰时段经常弹”服务器繁忙”,任务执行到一半可能卡住。对于习惯了”秒回”的人来说,这种异步等待需要一点耐心。

使用技巧

基础操作不难,但真正的好戏还在后面。很多人不知道还有这些进阶用法:

-

分阶段给指令:复杂任务先让 Manus 做信息收集,确认方向后再继续执行。这样既能避免方向偏离浪费积分,也能在关键节点介入调整。实测能省掉 30% 以上的无效消耗。 -

善用 Knowledge 记忆功能:在设置里开启偏好记忆后,Manus 会记住你的输出格式、语言风格和常用数据来源。下次类似任务直接沿用这些设置,不用每次重新描述一遍。 -

批量任务合并执行:把相关需求打包成一个指令发出。比如要做竞品分析时,一次性告诉它”对比 A、B、C 三家产品的功能、定价和用户评价”,会比逐家问要省一半多的积分。 -

利用异步执行做夜间任务:在下班前提交一个耗时较长的任务,比如”分析过去一年某行业的投融资数据并生成可视化图表”。第二天早上回来就能看到结果,完全不占用白天工作时间。

竞品对比

自己用着好不算,和同类产品放一起比比看。2026 年 AI Agent 赛道已经卷成红海,Devin、Cursor Agent、AutoGPT、Claude Code 各有拥趸。

| 对比维度 | Manus | Devin | Cursor Agent | Claude Code |

|---|---|---|---|---|

| 核心定位 | 通用自主 Agent | AI 软件工程师 | 日常编程辅助 | CLI 编程助手 |

| 研究能力 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ | ⭐⭐ |

| 编程任务成功率 | 50% | 60% | 75% | — |

| 代码质量 | B+ | A- | A | A |

| 价格 | $19/月起 | $100/月 | $20/月 | $20/月+API 用量 |

| 是否需人工介入 | 50% | 40% | 25% | 中等 |

和 OpenAI Deep Research 相比,Manus 的研究领域覆盖更广,不只是搜索摘要,还涉及数据采集、文件生成、网页操控。但 Deep Research 在单个深度研究任务上的精确度和速度更优。

核心差异在于定位:Cursor 是编程工具,Devin 是 AI 程序员,Claude Code 是终端助手。Manus 想当那个”什么都干得了”的万金油。好处是场景覆盖面广,坏处是每个方向的深度都不如专精的工具。选哪个,看你要解决什么问题。

用户反馈

参数上赢了,来听听真正用的人怎么说。社交媒体上关于 Manus 的讨论热度很高,但评价相当两极。

喜欢的人集中在研究和数据从业者:“它不只看前三个链接,它会深入挖掘”“给它一堆 CSV 文件,它自动分析后还给你画出可视化图表,这种感觉像是在 Excel 地狱里看到了出口”。Jack Dorsey 和 Hugging Face 的产品主管都公开称赞过它,业内甚至有人称它为”第二个 DeepSeek”。

吐槽的声音同样不小。积分消耗快是最普遍的抱怨,一个复杂任务几十分钟就烧掉几百点,免费额度根本不够用。服务器稳定性也屡被提及:”高峰期频繁弹’服务器繁忙’,有时候任务执行到一半就冻结了。”还有用户指出 Manus 偶尔会夸大自己的能力,MIT Technology Review 的测试也提到过类似问题,重要数据建议人工复核。

多维评分

评价有赞有踩,那从专业角度它能拿几分?

| 维度 | 评分 | 一句话解读 |

|---|---|---|

| 功能完整性 | ⭐⭐⭐⭐☆ | 覆盖 6 大模块,但编程深度不足 |

| 易用性 | ⭐⭐⭐⭐☆ | 对话式操作门槛低,异步等待需适应 |

| 性价比 | ⭐⭐⭐☆☆ | 免费版额度偏紧,Starter 计划合理 |

| 创新性 | ⭐⭐⭐⭐⭐ | 通用 Agent 概念的真正兑现者 |

| 稳定性 | ⭐⭐☆☆☆ | 服务器高峰期频繁报错,上下文受限 |

| 推荐度 | ⭐⭐⭐☆☆ | 研究场景强推荐,编程场景劝退 |

综合评分:6.8 / 10

扣分主要在稳定性和编程能力上。作为一个第一代产品,核心体验确实让人眼前一亮,但还不够”稳”,无论是服务器还是代码质量,都还有一条明显的成熟度差距。

优缺点

优势

-

多步骤自主执行:接收任务后自动拆解、规划、执行、交付,全程无需人工干预 -

深度研究能力出色:Wide Research 并行数百个子 Agent 搜索,信息覆盖率明显优于竞品 -

异步操作解放时间:云端后台持续执行,关掉电脑也能继续跑,适合过夜任务 -

交付物格式丰富:PDF 报告、HTML 页面、PPT、数据可视化图表,开箱即用

不足

-

编程开发能力弱:代码质量 B+,Bug 修复成功率仅 45%,远低于 Cursor 和 Claude Code -

服务器可靠性差:”服务器繁忙”频发,高峰期任务冻结是常见投诉 -

定价透明度低:积分消耗机制不透明,用户反映账户积分在无预警时被耗尽 -

收购风波带来不确定性:Meta 收购被国家发改委叫停后,产品未来走向不明朗

适用人群

分数摆在这了,那这东西到底最适合哪类人?

-

市场调研和行业分析师:整天要写竞品报告、做数据汇总。Manus 的 Wide Research 能把半天的工作量压缩到十多分钟,准确性也在可接受范围内。 -

小型创业者和独立开发者:预算有限但需要多面手。做竞品调研、生成网站落地页、分析用户数据,一个 Manus 能覆盖好几项工作。 -

营销和内容创作者:需要从多个来源整合信息、生成活动简报和内容日历。Manus 的数据聚合和可视化能力很适合这个场景。 -

编程为主的开发者:不太建议。写功能 55% 的成功率、Bug 修复 45%,在代码质量要求高的场景下,留给它的发挥空间太小。建议换成 Cursor 或 Claude Code。

定价方案

产品和人群对上了,来看看钱包受不受得了。

| 版本 | 月费 | 核心权益 | 限制 |

|---|---|---|---|

| Free 免费版 | $0 | 每天 300 积分、核心功能访问 | 邀请制,等待名单超 200 万 |

| Starter 入门版 | $39/月 | 3,900 积分、基本 Wide Research | 同时 2 个任务并行 |

| Pro 专业版 | $199/月 | 19,900 积分、完整 Wide Research | 同时 5 个任务并行 |

也有部分用户收到的定价方案中出现了 $19/月的基础版,官方渠道目前统一为 $39 起步。积分每月重置、不会累积,附加积分包可购买但永不过期。

如果你只是偶尔做做研究,免费版够用了,但前提是能拿到邀请。Starter 对个人用户来说性价比最高,重度使用者才需要考虑 Pro。和 Devin 的 $100/月、ChatGPT Plus 的 $20/月相比,Manus 的定价不算贵,但也不便宜,关键在于你的使用场景能否让它值回票价。

常见问题

价格说清楚了,有些细节你可能还想搞清楚。

Q1:Manus 有中文支持吗?

A1:支持中文输入和输出。 产品界面和任务对话都支持中文,但底层模型对英文内容的处理质量稍好。建议中文指令写清楚一些。

Q2:免费版每天能用多久?

A2:免费版每天 300 积分,约等于 3-5 个中等复杂度任务。 消耗速度视任务类型而定,简单问答几十点,Wide Research 可能一次烧掉几百点。

Q3:Manus 还需要下载安装吗?

A3:不需要,纯云端 Web 应用。 浏览器打开就能用。电脑关机也不影响已经在执行的任务,结果会后台上传到你的账户。

Q4:Manus 能商用吗?

A4:Pro 版以上支持商用授权。 免费版生成的报告和内容仅限个人使用,商用需购买付费套餐。

Q5:Manus 和 ChatGPT 有什么本质区别?

A5:ChatGPT 是对话助手,Manus 是自主执行 Agent。 ChatGPT 给你建议,你自己去做;Manus 直接拆解任务、调用工具、交付成品。

Q6:Manus 现在还能用吗?

A6:可以,但对中国大陆用户已暂停服务。 Manus 在 2026 年 1 月 5 日起停止对中国境内开放,海外用户可正常使用。收购案被叫停后的长期走向待观察。

Q7:Wide Research 和普通搜索有什么区别?

A7:同时派出几十到上百个子 Agent 并行搜索。 每个 Agent 独立负责一个数据源,最后自动汇总成带来源标注的结构化报告。不是摘要,是调研。

Q8:Manus 适合写代码吗?

A8:不太推荐。 实测编程任务成功率仅 50%,代码质量 B+。简单的脚本或页面生成可以,但复杂项目建议用 Cursor 或 Claude Code。

Q9:积分不够用怎么办?

A9:可以购买附加积分包,永不过期。 建议把复杂的 Wide Research 任务放在 Pro 版上跑,日常简单查询用聊天模式可以省不少积分。

Q10:Manus 会取代人类工作吗?

A10:目前不会,它是效率工具不是替代品。 研究报告和数据采集方面可以高度自动化,但最终判断和决策仍然需要人来把关。

最后总结

Manus 是一个思想领先于产品的典型案例。它第一个向市场证明了”AI 不该只聊天,应该直接帮你干活”这件事是可行的。Wide Research 和研究类任务的表现确实让人惊艳,敢说它做得比人类好的工具有几个?

但它也把初代产品的所有弱点暴露得彻彻底底。服务器撑不住流量、代码能力拉胯、定价体系不透明,再加上收购风波带来的不确定性,对于一个想放心依赖的工具来说,每一条都是硬伤。研究型从业者值得一试,纯开发者建议绕过。先试免费版,不行也不亏。