当我看到 Karpathy 开源 autoresearch 的时候,第一反应是:这老哥又来整活了。630 行代码?让 AI 自动跑实验?听起来像是那种”概念很酷但用起来很坑”的项目。但仔细研究了一下发现,这事儿可能比我想象的更有意思——它不是要替代研究员,而是把研究员从重复性的调参实验里解放出来。如果你也厌倦了手动改代码、跑训练、看结果的循环,这篇文章值得看完。

整体感受是:autoresearch 像是一个”AI 实验助手”,它不会替你思考研究方向,但能在你睡觉的时候帮你跑完 100 个实验,第二天告诉你哪个方向有戏。对于需要大量试错的研究场景,这简直是神器。

一、AutoResearch 是什么?

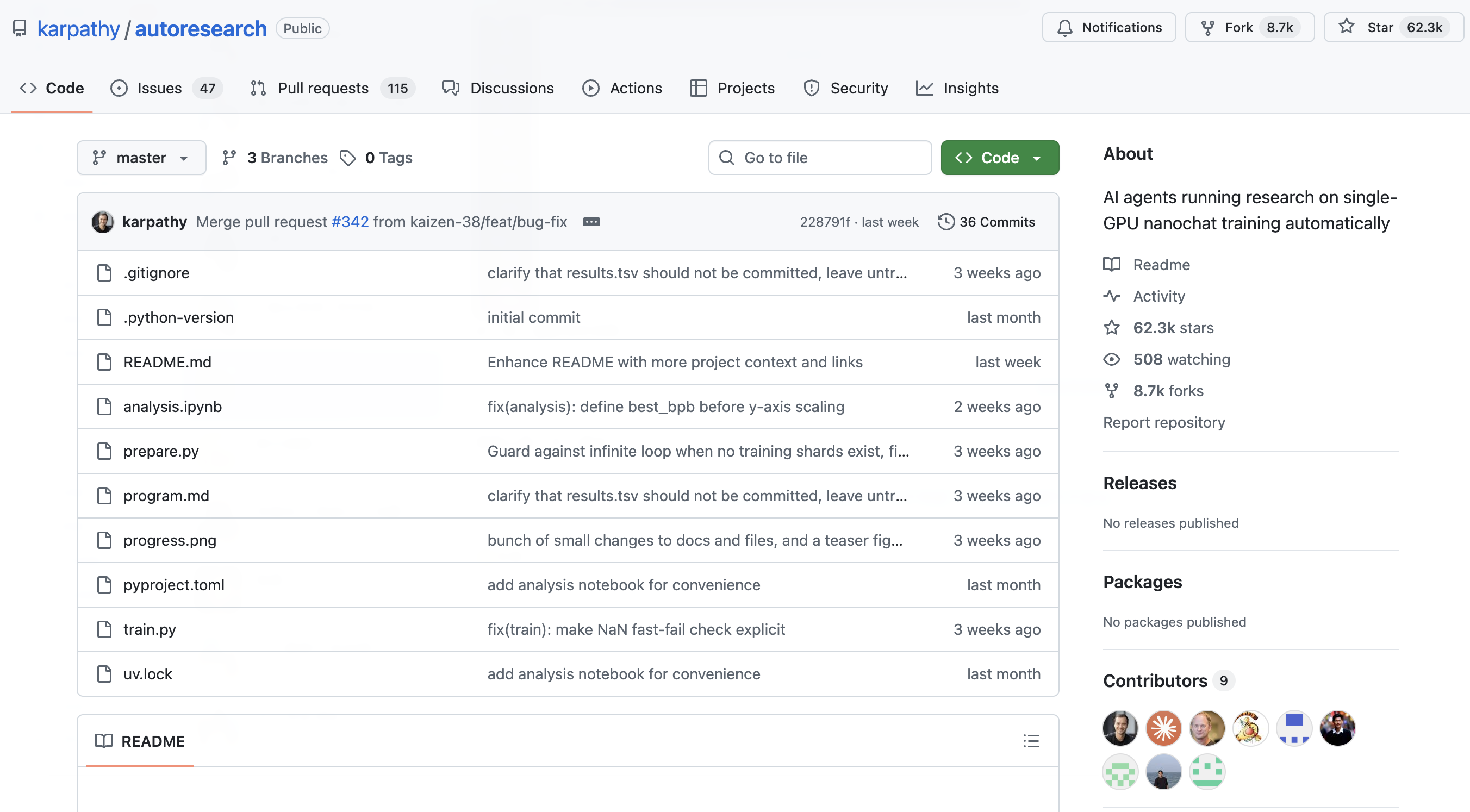

我还以为是某个大厂推出的企业级产品。结果一查发现,这是 Andrej Karpathy 的个人开源项目——对,就是那个前 OpenAI 创始成员、特斯拉 AI 总监、现在做 AI 教育的 Karpathy。

这个项目的定位很有意思:让 AI Agent 在单 GPU 上自主运行机器学习实验。简单来说,就是你给它一个研究方向(用自然语言写在 program.md 里),然后 AI 会自动修改训练代码、跑实验、评估结果,一晚上能跑几十上百次迭代。

整个项目只有 630 行 Python 代码,开源一周就在 GitHub 上狂揽 3.5 万星标。这热度背后,反映的是 ML 研究员们共同的痛点:调参实验太耗时了。

Karpathy 自己在项目描述里写了一句挺有意思的话:

“One day, frontier AI research used to be done by meat computers in between eating, sleeping, having other fun…”

翻译过来就是:以前前沿 AI 研究都是靠”肉做的计算机”(也就是人)在吃饭、睡觉、娱乐的间隙完成的。言下之意,以后这部分工作可以交给真正的计算机了。

二、AutoResearch 的用户规模和影响力

聊完产品定位,我们来看看数据。

| 指标 | 数据 |

|---|---|

| GitHub Star 数 | 35,000+(开源一周内) |

| 代码行数 | 约 630 行 |

| 核心文件数 | 3 个(prepare.py、train.py、program.md) |

| 单次实验时长 | 固定 5 分钟 |

| 实测实验次数 | 两晚约 700 次实验 |

这个增长速度在开源项目里算是现象级的。更值得关注的是社区的跟进速度——项目发布没几天,就出现了多个适配分支:

- MacOS 版本:miolini/autoresearch-macos

- MLX 版本:trevin-creator/autoresearch-mlx(Apple Silicon 优化)

- Windows 版本:jsegov/autoresearch-win-rtx

- AMD 版本:andyluo7/autoresearch

Shopify 的 CEO Tobi Lütke 甚至在社交媒体上分享,他们用 autoresearch 在内部模型上获得了 19% 的验证分数提升。这说明它不只是一个玩具,而是真的能产生实际价值。

三、AutoResearch 的核心功能有哪些?

🔬 自主实验循环

这是 autoresearch 的核心能力。AI Agent 会按照以下流程自动运行:

- 读取

program.md中的研究指令 - 检查当前

train.py和最近的实验结果 - 提出改进假设(如修改模型架构、调整超参数)

- 修改

train.py实现假设 - 提交代码变更到 git

- 运行 5 分钟训练

- 评估验证集指标(默认是 val_bpb,越低越好)

- 关键步骤:如果指标改善则保留,否则回滚到上一版本

这个机制被 Karpathy 称为”棘轮”(ratchet)——代码库只能向前(改善)演进,不会倒退。

⏱️ 固定时间预算

每次实验固定运行 5 分钟(墙钟时间),不依赖硬件性能。这个设计很聪明:

- 保证实验的可比性

- 防止某些实验跑太久阻塞整体进度

- 让研究员能预估一晚上能跑多少实验

📝 三文件架构

autoresearch 的极简设计体现在它的三文件架构上:

| 文件 | 作用 | 是否可被 AI 修改 |

|---|---|---|

| `prepare.py` | 数据预处理、评估指标计算 | ❌ 固定不变 |

| `train.py` | 模型架构、优化器、训练循环 | ✅ AI 的沙盒 |

| `program.md` | 研究指令、约束条件 | ✅ 研究员编写 |

这种设计确保了实验的公平性——所有修改都在 train.py 里,评估标准始终一致。

🔄 无人值守运行

启动后,代理可以连续运行数十到上百次实验。研究员可以安心睡觉,第二天来看实验日志和优化结果。Karpathy 实测两晚跑了约 700 次实验,筛选出 20 个有效优化。

四、AutoResearch 面向的人群有哪些?

| 用户类型 | 适合程度 | 使用场景 |

|---|---|---|

| ML 研究员 | ⭐⭐⭐⭐⭐ | 需要大量实验验证假设的研究工作 |

| 算法工程师 | ⭐⭐⭐⭐ | 模型调优、性能压榨 |

| AI 创业者 | ⭐⭐⭐ | 快速验证模型架构想法 |

| 初学者 | ⭐⭐ | 学习 ML 实验流程(需要一定基础) |

| 企业团队 | ⭐⭐⭐⭐ | 自动化模型优化流程 |

说实话,autoresearch 并不是零门槛的工具。你需要:

- 熟悉 Python 和 PyTorch

- 理解模型架构和训练流程

- 能够编写清晰的研究指令(

program.md) - 有 NVIDIA GPU(推荐 20GB+ 显存)

如果你是纯小白,建议先打好基础再来尝试。

五、AutoResearch 的应用场景有哪些?

场景一:模型架构搜索

让 AI 自动尝试不同的注意力机制变体、层数、隐藏维度等,找到最优配置。

场景二:超参数调优

自动调整学习率、batch size、dropout 率等超参数,寻找最佳组合。

场景三:优化器改进

测试不同的优化器设置、学习率调度策略、权重衰减等。

场景四:数据增强策略

自动尝试不同的数据预处理和增强方法。

场景五:性能压榨

在已有模型基础上,通过大量微实验榨取最后的性能提升。

六、AutoResearch 和同类竞品的差异有哪些?

| 特性 | AutoResearch | AutoML / HPO 工具 | 传统手动实验 |

|---|---|---|---|

| 代码修改能力 | ✅ 直接修改训练代码 | ❌ 仅调参 | ✅ 完全控制 |

| 实验速度 | ⚡ 5 分钟/次 | 视配置而定 | 🔧 人工控制 |

| 自动化程度 | 🤖 完全自动 | ⚙️ 半自动 | 👤 全手动 |

| 灵活性 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 学习成本 | 中等 | 较高 | 较低 |

| 成本 | 免费开源 | 通常付费 | 免费 |

与 Google 的 AutoML、Optuna 等超参数优化工具相比,autoresearch 的最大区别在于:它直接修改代码,而不仅仅是调参数。这给了它更大的灵活性,但也要求使用者对代码有更深的理解。

七、AutoResearch 有哪些使用技巧?

💡 技巧一:写好 program.md 是关键

program.md 是指导 AI 的唯一文件,要写清楚:

- 研究目标

- 允许修改的范围

- 评估标准

- 约束条件(如不能改 prepare.py)

💡 技巧二:从小规模开始测试

初次使用建议先用 TinyStories 等小数据集测试,确认流程正常后再上大规模实验。

💡 技巧三:监控 git 历史

通过 git log 可以清楚看到 AI 做了哪些修改,方便复盘和学习。

💡 技巧四:设置合理的评估指标

默认使用 val_bpb(每字节位数),但你可以根据任务自定义评估指标。

💡 技巧五:结合本地 LLM 降低成本

社区有教程介绍如何用 Ollama + Qwen 等本地模型运行 autoresearch,可以节省 API 费用。

八、AutoResearch 对于企业和个人有哪些价值?

| 价值维度 | 企业用户 | 个人用户 |

|---|---|---|

| 时间节省 | 研究员可以专注于创新,把调参交给 AI | 加速学习和实验迭代 |

| 成本降低 | 减少重复性人力投入 | 免费开源,零成本使用 |

| 效率提升 | 一晚上跑 100 个实验,快速验证想法 | 快速积累实验经验 |

| 知识沉淀 | 实验过程自动记录在 git 中 | 学习 AI 的”思考”过程 |

九、AutoResearch 的产品定价是怎样的?

| 版本 | 价格 | 说明 |

|---|---|---|

| 开源版 | 免费 | 完整功能,MIT 协议 |

| API 费用 | 按需 | 使用 Claude/Codex 等 AI 代理的 API 费用 |

| 硬件成本 | 按需 | 需要 GPU(可用云服务器) |

autoresearch 本身是免费开源的,主要成本来自:

- AI 代理 API:Claude、Codex 等按 token 收费

- GPU 资源:自建或租用云 GPU

如果预算有限,可以参考社区教程使用本地 LLM(如 Qwen、Llama)替代商业 API。

十、AutoResearch 的官网和下载地址

- GitHub 仓库:https://github.com/karpathy/autoresearch

- 社区分支:

– MacOS: https://github.com/miolini/autoresearch-macos

– MLX: https://github.com/trevin-creator/autoresearch-mlx

– Windows: https://github.com/jsegov/autoresearch-win-rtx

– AMD: https://github.com/andyluo7/autoresearch

总体评价

autoresearch 是一个很有想法的项目,它不是要替代研究员,而是把研究员从重复性的实验工作中解放出来。630 行代码能做到这个程度,Karpathy 的代码功力确实深厚。

但说实话,它也有明显的局限性:

- 创造力天花板:棘轮机制只接受立即带来改善的变更,无法进行”先退后进”的探索

- 容易陷入局部最优:AI 可能会反复尝试类似的微调

- 5 分钟限制:某些需要更长时间训练才能显现优势的改进可能被错过

所以我的建议是:把它当作”实验助手”而不是”自动研究员”。研究方向和核心创新还是要靠人,autoresearch 帮你快速验证和优化。

评分(满分 5 星)

- 易用性:⭐⭐⭐(3/5)需要一定的 ML 基础

- 功能性:⭐⭐⭐⭐(4/5)核心功能完整,但还有改进空间

- 稳定性:⭐⭐⭐⭐(4/5)代码简洁,bug 较少

- 扩展性:⭐⭐⭐⭐(4/5)开源架构,社区活跃

- 性价比:⭐⭐⭐⭐⭐(5/5)免费开源,价值巨大

综合评分:4/5 星

一句话总结

autoresearch 是 ML 研究员的”夜班助手”——你睡觉,它炼丹,第二天早上告诉你哪个方向有戏。